當全球AI視頻生成領域還在為提升畫質、延長時長而激烈競爭時,一家名為Xmax AI的初創公司正以顛覆性創新重新定義行業規則。這家由前華為"天才少年"領銜的團隊,近日推出了全球首個實現虛實融合的實時交互視頻生成模型X1,通過毫秒級響應與低門檻手勢操作,將AI視頻從"被動觀看"推向"主動共創"的新紀元。

在傳統AI視頻生成場景中,用戶往往需要輸入復雜指令,經歷漫長渲染等待,最終獲得的仍是單向輸出的預制內容。X1模型徹底打破了這種桎梏——通過手機攝像頭對準桌面,用戶選取的滾球獸照片可瞬間"躍出"屏幕,不僅會隨著手勢撫摸轉頭蹭手,被輕捏時還會產生Q彈物理反饋,甚至能被穩穩托在掌心。這種突破次元壁的交互體驗,得益于團隊獨創的端到端流式重渲染架構與幀級自回歸DiT模型,將擴散采樣速度提升百倍的同時,實現了對捏、拖拽等復雜手勢的精準解析。

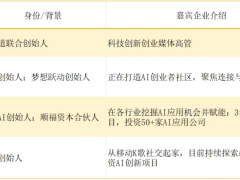

技術突破的背后是跨學科團隊的協同攻堅。來自清華KEG實驗室、香港科技大學(廣州)及字節跳動的頂尖人才,構建了統一交互模型架構,融合空間三維關系與屏幕二維操作。針對虛實融合數據稀缺的難題,團隊開發出半自動化合成管線,既筑牢技術壁壘,又為我國AI視頻領域儲備了關鍵數字資產。這種硬核實力使X1在四大核心場景中展現驚人表現:上傳任意角色圖可實現次元互動,撫摸屏幕中的兔子會觸發轉頭蹭手的動態響應;選擇梵高畫作或樂高積木圖,現實場景可實時轉化為風格化世界;拖拽照片中角色的耳朵或嘴角,靜態圖像即刻產生搖頭微笑的生動反應;對準朋友選擇Emoji,還能瞬間生成魔性動態表情包。

相較于2024年全球AI視頻生成市場6.148億美元的規模,Xmax AI選擇了一條更具挑戰性的道路。當Sora、Runway等巨頭仍在影視廣告領域爭奪專業用戶時,X1模型通過技術演示應用X-cam已向大眾開放體驗。用戶無需復雜操作,僅憑直覺手勢就能讓幻想掙脫屏幕束縛,這種"人人可玩"的交互范式,或許正預示著下一代內容引擎的雛形。正如團隊Slogan所言"Play the World through AI",當技術突破想象邊界,每個普通用戶都能成為數字世界的創造者。