在全球智算集群邁向“十萬卡”規模的新階段,傳統單機八卡服務器因集群通信開銷激增,難以支撐超萬億參數模型的訓練需求,算力線性增長遭遇瓶頸。以強互聯能力為核心的超節點架構正成為行業技術演進的關鍵方向,推動智算基礎設施向更高密度、更低時延的方向突破。

近日,由摩爾線程、中國移動研究院、之江實驗室等機構聯合制定的《OISA高密超節點參考設計技術規范》正式發布。該規范針對智算中心面臨的互聯帶寬不足、供電壓力劇增、散熱效率低下等核心挑戰,提出了一套覆蓋硬件架構、供電系統、冷卻技術的全棧解決方案,為構建自主可控的高性能智算集群提供了關鍵技術支撐。

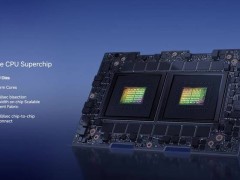

在硬件架構層面,OISA高密超節點通過物理空間與邏輯拓撲的雙重創新,實現了算力密度的指數級提升。設計采用大尺寸高密線纜技術,在標準單寬機柜內實現128卡全互聯,并支持通過并柜擴展至256卡部署,單位面積算力產出較傳統架構提升數倍。基于OISA 2.0協議的原生內存語義支持,跨節點數據訪問實現無障礙傳輸,配合報文重構技術將卡間帶寬推向TB/s級別,時延壓縮至數百納秒量級。這種“高密度物理布局+高帶寬邏輯互聯”的協同設計,不僅兼容多廠商國產芯片,更為大規模模型訓練創造了近似單機性能的分布式計算環境。

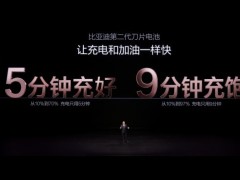

面對單GPU功耗突破700W、機柜功率向350kW演進的挑戰,OISA參考設計在供電與冷卻系統上實現革命性突破。供電方案引入高壓直流系統與柜內集中供電技術,通過減少電力轉換層級將能耗損耗降低30%以上,為高密度算力部署提供穩定動力。冷卻系統則將液冷技術從可選方案升級為原生配置,針對單GPU 2kW以上的散熱需求優化流道設計,配合智能診斷系統實時監測流量、壓力、溫度參數,使PUE值從風冷時代的1.4降至1.05-1.15區間,導熱效率提升達數千倍,為智算產業綠色轉型開辟新路徑。

該規范的發布標志著智算基礎設施進入體系化合作新階段。通過整合芯片廠商、設備制造商、科研機構等產業鏈資源,OISA平臺構建起覆蓋芯片設計、設備集成、應用開發的完整生態,為行業提供多元化技術路徑選擇。目前,中國移動、之江實驗室等機構已啟動規模化部署試點,并計劃聯合更多合作伙伴開展定制化方案設計,推動Chiplet、光互連、內存池等前沿技術與超節點架構的深度融合,持續探索計算性能極限。