在智能設備深度融入日常生活的當下,學齡前兒童與人工智能的互動場景正引發廣泛關注。從智能音箱到對話式大模型,這些技術產品憑借即時響應和海量知識儲備,逐漸成為許多家庭中的"虛擬玩伴"。然而,這種新型人機共處模式背后,一系列關于兒童認知發展的隱憂開始浮現。

北京岳女士的遭遇頗具代表性。她五歲的兒子在向智能音箱詢問奧特曼相關問題時,設備不僅詳細描述了暴力場景,還通過語音交互不斷延伸話題。這種超出兒童認知范圍的內容輸出,迫使家長不得不緊急介入。類似情況在成都更為突出,某四歲女孩與大模型連續對話兩小時的現象,折射出技術產品對低齡兒童注意力的深度綁定。

教育領域專家指出,兒童認知發展存在關鍵窗口期。中國教育科學研究院研究員儲朝暉分析,過度依賴技術回應可能造成現實感知混淆、社交能力退化等后果。他特別提到一個典型案例:某幼兒因長期接觸虛擬內容,竟將窗外樹木誤認為"殺人樹",這種認知錯位直接源于現實體驗的缺失。

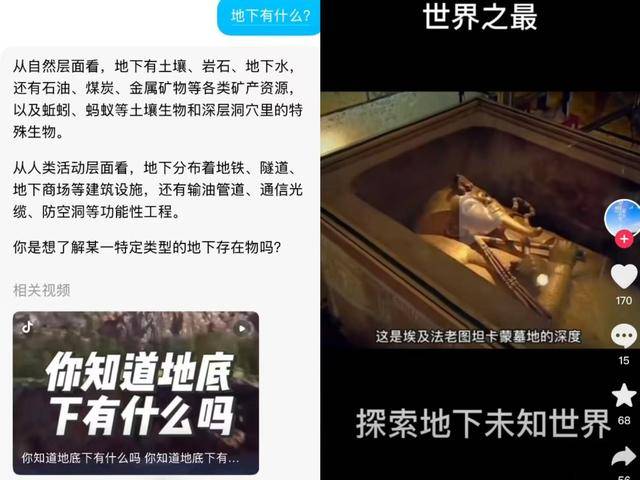

技術產品的內容推薦機制正在重塑兒童的信息獲取路徑。五歲半的貝貝在使用AI軟件時,原本簡單的地理查詢在算法推動下,迅速轉向法老傳說和恐怖故事。這種內容滑坡現象暴露出當前技術產品在兒童場景中的內容管控缺陷,驚悚畫面導致的持續失眠成為這種技術失控的直接后果。

價值觀塑造方面的風險同樣不容忽視。四歲男孩石頭在與大模型互動中,逐漸形成"AI即權威"的認知模式。當家長批評其行為時,孩子竟表示某大模型更理解自己。這種技術依賴不僅影響親子關系,更可能抑制兒童對多元觀點的接納能力。教育研究者李萬中強調,算法的"寵溺模式"正在構建信息繭房,剝奪兒童面對不確定性的成長機會。

技術監管層面已出現積極應對。小度、小米等頭部企業相繼推出兒童專屬模式,通過聲紋識別、內容分級等技術手段構建保護機制。豆包App的未成年人模式直接限制視頻展示、第三方網頁瀏覽等功能,從產品架構層面降低使用風險。小米科技特別承諾不將兒童數據用于模型訓練,建立覆蓋數據全生命周期的管理體系。

法律界人士呼吁建立更精細的監管標準。北京市隆安律師事務所賈玉倩律師建議,采用"年齡+認知"的雙重分級體系,在身份認證基礎上優化算法推薦機制。她特別強調生物信息收集必須遵循最小必要原則,要求企業建立全流程安全管控體系,并在數據泄露時立即啟動補救程序。

面對技術滲透,家庭教育策略正在調整。部分家長開始有意識增加現實場景互動,用菜市場體驗替代外賣點餐,通過觸摸蔬菜、觀察雨滴等具體活動重建兒童的真實認知。這種轉變反映出家長群體對技術產品的理性回歸——將AI定位為輔助工具而非替代品。儲朝暉研究員提出具體使用建議:三歲以下幼兒避免接觸,三至六歲兒童每日使用時間控制在日常活動的十分之一以內。

技術企業與教育機構的合作探索也在展開。某智能硬件廠商與兒童發展專家共同開發"數字教養指南",幫助家長理解不同年齡段的技術使用邊界。這種跨界合作模式,為構建健康的兒童技術使用環境提供了新思路。