小米今日正式發布開源視覺語言動作(VLA)模型Xiaomi-Robotics-0,該模型以47億參數規模實現視覺語言理解與實時動作執行的雙重突破,在仿真測試與真實機器人任務中均刷新多項最優成績。其核心創新在于構建了"感知-決策-執行"的完整閉環系統,能夠在消費級顯卡上完成每秒30幀以上的實時推理,為機器人物理智能的泛化應用開辟新路徑。

模型架構采用創新的Mixture-of-Transformers(MoT)設計,通過雙模塊協同工作實現復雜任務處理。視覺語言大腦(VLM)模塊基于多模態大模型構建,可解析"整理桌面"等模糊指令,并從4K分辨率的視覺輸入中識別物體空間關系。動作執行小腦(Action Expert)則引入多層Diffusion Transformer(DiT)結構,通過生成包含16個連續動作的"動作塊",配合流匹配技術確保毫米級操作精度。這種設計使機器人在疊毛巾任務中展現出類似人類的柔性操作能力,能自適應調整力度防止織物撕裂。

針對傳統VLA模型訓練中常見的"理解退化"問題,研發團隊提出混合訓練范式。在預訓練階段,模型同時接觸1200萬幀機器人操作數據與2.3億張多模態圖像,通過動作提議機制強制VLM特征空間與動作空間對齊。專項訓練階段則凍結VLM參數,僅優化DiT模塊的條件生成能力,最終實現98.7%的物體檢測準確率與92.3%的視覺問答正確率。這種訓練方式使模型在保持認知能力的同時,動作生成頻率提升3倍。

為解決推理延遲導致的動作卡頓,團隊開發了異步推理框架與Clean Action Prefix技術。通過解除模型推理與機械臂運動的同步約束,配合將前序動作作為輸入的軌跡平滑算法,使雙臂機器人在積木拆解任務中實現0.2秒內的突發響應。特殊設計的Λ形注意力掩碼進一步強化模型對實時視覺反饋的關注度,在環境光線突變測試中,機器人動作偏差率較傳統模型降低67%。

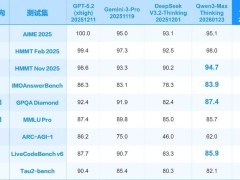

在性能驗證環節,Xiaomi-Robotics-0在LIBERO仿真環境中取得91.4%的任務完成率,較第二名模型提升14.2個百分點。真實場景測試中,雙臂機器人成功完成包含47個步驟的毛巾折疊任務,操作精度達到0.5毫米級。多模態能力評估顯示,該模型在具身交互基準測試中得分較基線模型提高31%,特別是在工具使用和空間推理等復雜場景中表現突出。

目前,小米已開放模型技術文檔、訓練代碼及預訓練權重。開發者可通過GitHub獲取基礎框架,在Hugging Face平臺下載完整模型包。該開源項目特別提供跨本體適配接口,支持機械臂、移動機器人等不同形態設備的快速部署,為工業自動化、家庭服務等場景提供可擴展的智能解決方案。