“為何不共同探索一個充滿希望的未來?為何不在創新、想象與治愈的道路上走得更遠?”在亞馬遜云科技(AWS)第14屆re:Invent全球大會上,一連串發人深省的問題拉開了這場科技盛宴的序幕。作為全球云計算領域的領軍者,AWS在2025年交出了一份令人矚目的成績單:第三季度營收同比增長超20%,全年營收有望突破1320億美元,資本支出預計達1250億美元,創下歷史新高。

在生成式人工智能(AI)浪潮的推動下,AWS正加速前行。其Amazon Bedrock平臺服務的客戶數量在一年內實現翻倍,其中處理超萬億規模tokens的客戶已超過50家。這一數據背后,是AWS對AI基礎設施的深度布局與持續創新。面對全球AI產業處于關鍵轉折點的現狀,AWS提出一個大膽的設想:為何不重構整個社會創新的基石?

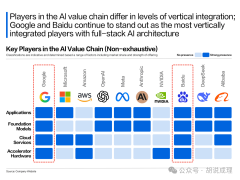

在AI基礎設施領域,AWS展現出全棧自研的雄心。亞馬遜云科技大中華區產品部總經理陳曉建指出,要打造一個具備強大擴展性、最佳性能與最低成本的基礎設施,必須從軟件到硬件進行全棧優化,而AWS正是唯一具備這種能力的企業。在re:Invent大會上,AWS展示了從基礎芯片、計算實例、模型平臺到應用工具的完整技術棧,其中芯片無疑是核心環節。

陳曉建透露了自研訓推芯片Amazon Trainium 3的最新進展。作為AWS首款基于3nm工藝的芯片,Trainium 3在計算性能、能效、內存容量與帶寬等方面均實現顯著提升。其計算性能是Trainium2的4.4倍,能效提高40%,內存容量增至144GB HBM3e,帶寬提升1.7倍。更引人注目的是,Trainium 3支持大規模Ultra Servers與Ultra Clusters部署,單個服務器最多可集成144個芯片,集群規模可擴展至數十萬甚至上百萬芯片。

自研芯片的優勢在于成本與性能的雙重優化。相較于通用架構的英偉達GPU,ASIC架構的Trainium 3專為AI訓練設計,去除了不必要的圖形渲染、游戲優化等模塊,從而在固定AI任務上實現更高的性能密度與能效。據透露,Anthropic、Karakuri等客戶已通過Trainium將訓練與推理成本降低至原來的50%。目前,AWS已部署超過100萬顆Trainium芯片,業務規模達數十億美元,尤其在Amazon Bedrock平臺上,絕大部分推理服務已通過Trainium實現。

AWS的自研野心不止于算力芯片。自2017年投入自研芯片以來,AWS已形成三條產品線:基于Arm架構的Graviton系列負責通用計算,Trainium和Inferentia專攻AI訓練與推理,Nitro系統芯片則負責網絡、存儲與安全功能的卸載。AWS還在構建一個閉環的AI基礎設施生態,從芯片到實例計算,從存儲到數據庫,從訓練到推理,形成全方位覆蓋。

在本次re:Invent大會上,AWS推出了一項創新產品——Amazon AI Factory。這是一個私有的AWS區域,允許客戶利用自身數據中心與電力容量,由AWS協助建設最先進的AI基礎設施。該方案整合了最新的英偉達GPU、Amazon Trainium芯片以及Amazon SageMaker和Bedrock平臺,為每個客戶獨立運營,確保資源與業務的完全隔離,同時保持與AWS相同的安全性與可靠性。這一模式為因數據主權、監管合規等因素無法采用公有云的客戶提供了新的選擇。

如果說基礎設施是土壤,那么Agent(智能體)則是這片土地上結出的果實。2025年被稱為Agent元年,AWS正以務實的方法論推動Agent的落地應用。亞馬遜云科技大中華區解決方案架構總經理代聞指出,企業逐漸意識到,不存在一個“萬能”的大模型,企業的知識與流程才是核心資產,而Agent則是將這些資產轉化為生產力的工程化手段。

在亞馬遜內部,Agent的應用已超過4萬個。代聞發現,Agent的普及不僅帶來工具的更新,更推動生產關系的重構。首先是組織形態的重塑,人機協作成為常態,傳統的線性管理模式逐漸失效,企業需要建立新的協作范式與組織方法論。其次是角色邊界的重塑,個體職能向“AI指揮官”轉變,配套工具的重要性日益凸顯。

代聞以銷售與開發場景為例,說明Agent如何提升效率。在銷售場景中,經理可利用Amazon Quick Suite生成詳盡的客戶報告,自動整合客戶最新上市信息、輿情與內網歷史交易數據,大幅提升拜訪前的準備效率。在開發場景中,產品經理(PM)可借助AI“召喚”工程師協助制作原型,實現想法的快速驗證,無需依賴研發排期。

企業擁抱AI的模式主要有兩種:一種是成立小規模新團隊,充分擁抱AI原生工作狀態;另一種是對原有開發團隊進行轉型,這需要強有力的制度指引與工具支持。代聞認為,真正的變革需要“推”“拉”結合:“推”是設計新的KPI考核方式,“拉”是提供好用的工具。他引用一句名言:“工作屬于你,而不是工具。”在AI時代,這種對技術的“自驅力”將變得更加重要。