螞蟻百靈近日正式發布了一款名為 Ling-2.6-flash 的 Instruct 模型,該模型以“Token 效率”為核心優勢,總參數量達 104B,激活參數為 7.4B。在保持高智能水平的同時,Ling-2.6-flash 在速度、成本和實際應用方面表現出色,尤其適合大規模真實場景部署。

根據第三方權威評測機構 Artificial Analysis 的數據,Ling-2.6-flash 在輸出 15M tokens 的情況下,取得了 26 分的 Intelligence Index,展現了卓越的 Token 效率。與一些依賴更長輸出以換取更高分數的模型相比,Ling-2.6-flash 在智能表現和輸出成本之間實現了更優的平衡。

對于開發者和企業用戶而言,Ling-2.6-flash 的效率優勢體現在多個方面:推理開銷更低、首字響應更快、整體生成時延更短,從而帶來更流暢的交互體驗。這些特點使其能夠滿足真實部署環境下對速度、成本和用戶體驗的綜合需求。

在架構設計上,Ling-2.6-flash 延續了 Ling 2.5 的混合線性架構,采用高度稀疏化的 MoE 架構,在硬件性能上表現突出。在 4 卡 H20 條件下,其推理速度最快可達 340 tokens/s,Prefill 吞吐量是 Nemotron-3-Super 的 2.2 倍。在 Output Speed 測評中,Ling-2.6-flash 以 215 tokens/s 的穩定輸出速度躋身同參數級別模型的第一梯隊。

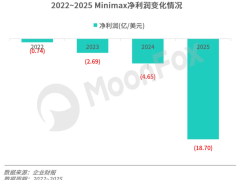

從 Token 消耗來看,Ling-2.6-flash 的智效比顯著提升。在 Artificial Analysis 的完整測評中,其總消耗僅為 15M tokens,而 Nemotron-3-Super 等模型則達到或超過 110M tokens。這意味著 Ling-2.6-flash 僅用約 1/10 的 Token 消耗就完成了同類評測任務。

Ling-2.6-flash 還針對 Agent 場景進行了定向優化,在控制 Token 消耗的前提下,依然保持了強大的任務執行能力。該模型在 BFCL-V4、TAU2-bench、SWE-bench Verified、Claw-eval、PinchBench 等 Agent 相關基準測試中達到同尺寸模型的 SOTA 水平。同時,它在通用知識、數學推理、指令遵循及長文本解析等維度也保持了優秀表現。

在 API 定價方面,Ling-2.6-flash 提供了極具競爭力的價格:輸入每百萬 tokens 定價 0.1 美元,輸出 0.3 美元。目前,該模型的 API 已正式向用戶開放,并提供為期一周的限時免費試用。用戶可以通過 OpenRouter 或百靈大模型 tbox 獲取服務。據悉,螞蟻數科后續將發布 Ling-2.6-flash 的商業版本 LingDT,面向全球開發者及中小企業提供服務。

值得一提的是,一周前,Ling-2.6-flash 的匿名測試版本“Elephant Alpha”已在 OpenRouter 上線。自上線以來,其調用量持續增長,連續多日位居 Trending 榜首,日均 tokens 調用量達 100B 級別,周增長率超過 5000%。